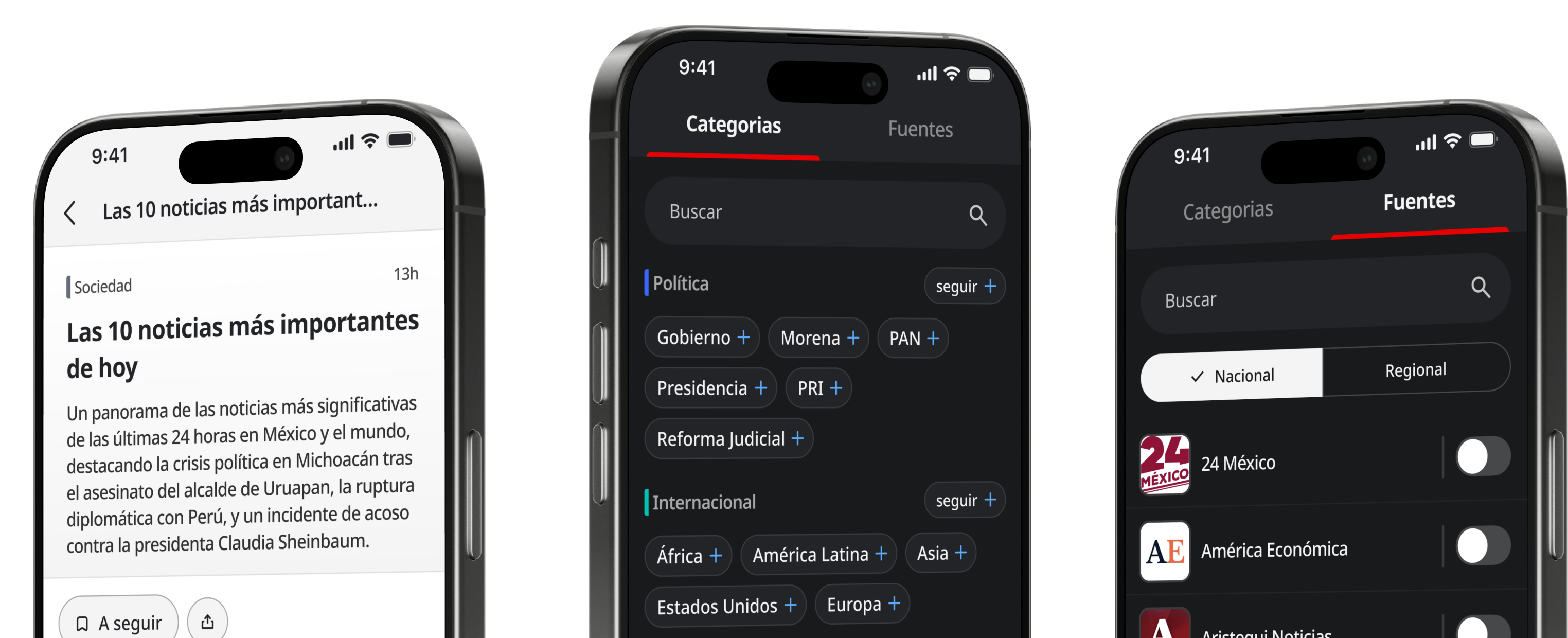

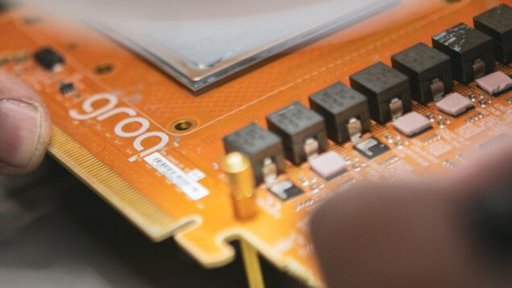

Nvidia licencia la tecnología de la startup Groq y contrata a su CEO para fortalecerse en el mercado de la IA

Nvidia acordó una licencia no exclusiva para utilizar la tecnología de chips de la startup Groq y contratar a su fundador y CEO, Jonathan Ross, junto con otros miembros clave de su equipo de ingeniería. Aunque un informe de CNBC mencionó una posible adquisición por 20,000 millones de dólares, Groq confirmó que seguirá operando como una empresa independiente.

El acuerdo no tuvo cifras oficiales reveladas.

Este movimiento estratégico busca reforzar la posición de Nvidia en el campo de la inferencia, que es el proceso en el que los modelos de IA ya entrenados responden a las solicitudes de los usuarios en tiempo real. Si bien Nvidia domina el mercado del entrenamiento de modelos, enfrenta una competencia creciente en la inferencia por parte de rivales como Advanced Micro Devices y startups especializadas como Groq y Cerebras Systems. La tecnología de Groq es particularmente valiosa en esta área, ya que utiliza una arquitectura de chip con memoria SRAM integrada que acelera las respuestas y reduce la latencia, aunque limita el tamaño de los modelos que puede manejar. La operación Nvidia-Groq es parte de una tendencia más amplia en Silicon Valley, donde las grandes corporaciones tecnológicas aseguran talento y tecnología críticos a través de acuerdos de licencia y contrataciones estratégicas en lugar de fusiones y adquisiciones tradicionales.

Este método, que ha sido utilizado por empresas como Microsoft, Meta y Amazon, les permite crecer y consolidar poder mientras intentan evitar el escrutinio de los reguladores antimonopolio. Analistas advierten que, a pesar de la estructura de los acuerdos, el riesgo regulatorio persiste. El acuerdo se produce en un contexto de inversiones multimillonarias en toda la industria de la IA para satisfacer la creciente demanda de infraestructura y potencia de cómputo. Empresas como OpenAI, Meta, Microsoft y Google han cerrado acuerdos por miles de millones de dólares en áreas como chips, computación en la nube y centros de datos, demostrando la intensa carrera por liderar el futuro de la inteligencia artificial.

Artículos

6